Meta-Angaben sind für die Suchmaschinenoptimierung weiterhin so wichtig wie eh und je. Dabei ist das Meta Robots Tag zusammen mit der Meta Description die wichtigste Angabe, die für einzelne Seiten vorgenommen werden kann. Welche Einstellungen es gibt und wie Sie die Meta Robots und X-Robots Angaben schnell kontrollieren können, erfahren Sie in diesem Artikel.

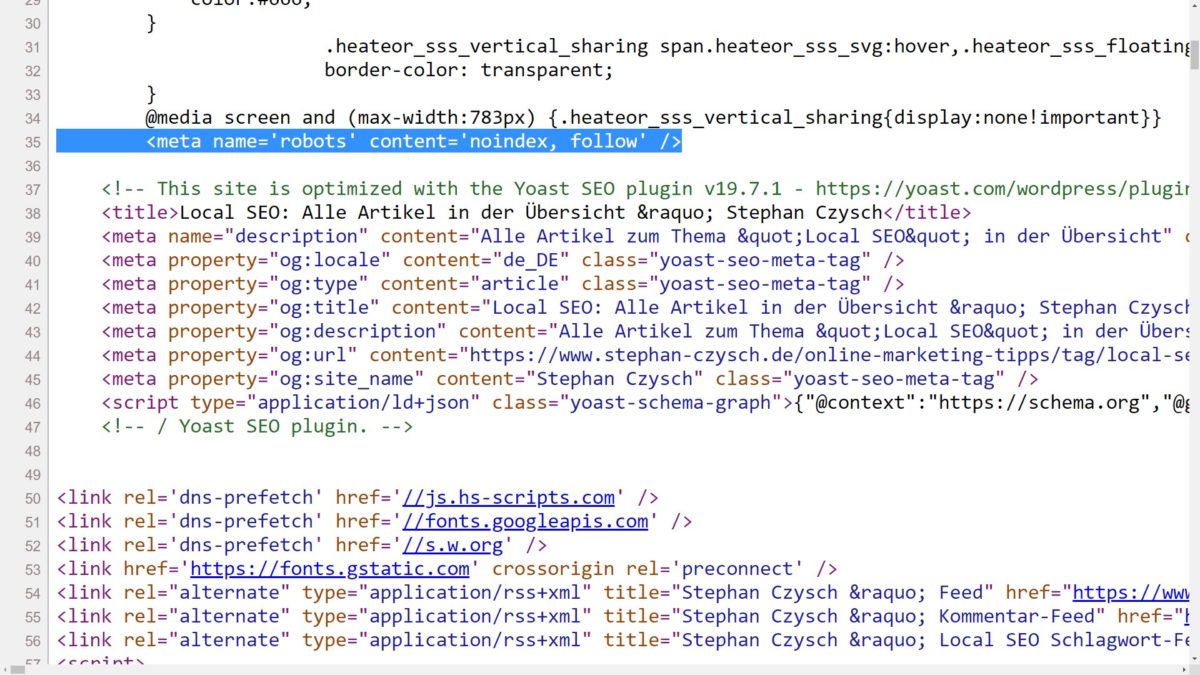

Die Meta Robots Angabe soll immer im <head> Bereich einer Seite gesetzt werden. Zwar gibt es seitens der Suchmaschinen eine gewisse Fehlertoleranz, diese sollten Sie allerdings nicht austesten.

Mit der nachfolgend zu sehenden noindex,nofollow-Anweisung werden Suchmaschinen angewiesen, die Seite nicht zu indexieren und den ausgehenden Links nicht zu folgen

<!DOCTYPE html>

<html><head>

<meta name="robots" content="noindex,nofollow" />

(…)

</head>

<body>(…)</body>

</html>Warum wird meine Seite trotz dieser Anweisung gefunden? Das liegt daran, dass die Angabe in einem <code>-Feld steht und dadurch nicht die Indexierung der Seite beeinflusst.

Diese Angaben unterstützt Google im Meta Robots Tag

Google hat rund um Meta Robots einen eigenen Hilfeartikel erstellt. In diesem Artikel werden die unterstützten Angaben aufgelistet. Zudem wird auf X-Robots eingegangen.

X-Robots stellt eine Alternative zu Meta Robots dar und hat den Vorteil, dass die Angabe auch für nicht-HTML-Dokumente wie .pdf oder .xlsx verwendet werden kann. In diesem Fall wird die Anweisung an Crawler über den sogenannten HTTP-Header gesendet. Vereinfacht gesagt, ist das die Kommunikationsschnittstelle zwischen Endgerät (meistens Browser) und Webserver. Im HTTP-Header werden z.B. die Statuscodes einer Adresse übermittelt.

| Anweisung | Bedeutung |

noindex | Die Seite soll nicht in den Index einer Suchmaschine aufgenommen werden |

nofollow | Wenn im <head> definiert, dann soll keinem der Links auf der Seite gefolgt werden |

none | Diese Angabe entspricht noindex, nofollow |

noarchive | Verhindert, dass eine Seite zwischengespeichert wird (im sogenannten Cache). Mit cache:URL können Sie das Cache-Abbild einer Seite bei Google ansehen. |

nosnippet | Die Meta Description soll nicht angezeigt werden |

notranslate | In den Suchergebnissen von Google soll keine Übersetzung der Seite angeboten werden |

noimageindex | Die auf der Seite enthaltenen Bilder sollen nicht indexiert werden. |

unavailable_after | Definiert das Datum, ab wann die Seite nicht mehr in den Suchergebnissen auftauchen soll (RFC-850 Format) |

Die Robots Angaben kontrollieren

Fehlerhafte Robots Angaben können sich sehr deutlich auf die Sichtbarkeit einzelner Unterseiten auswirken. Aus diesem Fall sollten Sie mit den Angaben sehr bewusst vorgehen. Anstatt einen Blick in den Quelltext oder gar den HTTP-Header einer Seite zu werfen, können Sie die Robots Anweisungen komfortabel über Browerplugins analysieren.

Meine Empfehlung ist der Robots Exclusion Checker für den Chrome-Browser. Das Plugin untersucht eine Seite auf die Indexierungseinstellung und zeigt sowohl Meta Robots, X-Robots, Canonical und robots.txt Blockierungen an.

Beispiele für Meta Robots Angaben

Meta Robots Angaben können beliebig kombiniert werden. Allerdings ist nicht jede Kombination wirklich sinnvoll, da sich die einzelnen Angaben widersprechen. Nutzen Sie beispielsweise noindex, dann ist eine noarchive-Angabe nicht sinnvoll, da die Seite sowieso nicht im Index der Suchmaschine enthalten ist und deshalb auch nicht zwischengespeichert wird.

Die unterschiedlichen Angaben müssen durch ein Komma voneinander getrennt sein. Ob Sie nach dem Komma ein Leerzeichen setzen oder nicht ist Ihnen überlassen, auch Groß- und Kleinschreibung ist kein Problem. Zudem müssen die Angaben nicht, z.B. alphabetisch, sortiert sein.

Nachfolgend ein paar Beispielangaben

- Adresse nicht indexieren lassen und keinen der Links folgen

<meta name="robots" content="noindex,nofollow">- Kein Snippet anzeigen und keinen Links folgen

<meta name="robots" content="nosnippet,nofollow">Wenn Sie möchten, dann können Sie separate Angaben für Google verwenden. In diesem Fall verwenden Sie nicht name="robots", sondern name="googlebot". Nutzen Sie beide Angaben, dann kombiniert Google die Anweisungen. Aus

<meta name="robots" content="nosnippet,nofollow">

<meta name="googlebot" content="noindex">wird folglich ein nosnippet,nofollow,noindex.

Beispiel für ein X-Robots HTTP-Header

Werfen wir einen Blick auf die X-Robots Angabe. Zur Erinnerung: Die Angabe wird über den HTTP-Header übermittelt.

Wenn Sie den HTTP-Header einer Seite ansehen möchten, dann können Sie dies in den meisten Browsern durch das Drücken der Taste F12 sowie Auswahl von „Netzwerk“ einsehen. Alternativ können Tools wie https://httpstatus.io/ verwendet werden.

HTTP/1.1 200 OK

Date: Tue, 30 Jun 2019 21:42:43 GMT

(…)

X-Robots-Tag: nosnippet

X-Robots-Tag: unavailable_after: 30 Jun 2022 16:30:00 PST

(…)

Schreibe einen Kommentar